- Libri preferiti

Accedi all'area personale per aggiungere e visualizzare i tuoi libri preferiti

Accedi all'area personale per aggiungere e visualizzare i tuoi libri preferiti

L'informatica è la scienza che si occupa del trattamento dell'informazione mediante procedure automatizzate, avendo in particolare per oggetto lo studio dei fondamenti teorici dell'informazione, della sua computazione a livello logico e delle tecniche pratiche per la sua implementazione e applicazione in sistemi elettronici automatizzati detti quindi sistemi informatici; come tale è una disciplina fortemente connessa con la logica matematica, l'automatica, l'elettronica e anche l'elettromeccanica. Si accompagna e si integra o è di supporto a tutte le discipline scientifiche, e come tecnologia pervade pressoché qualunque "mezzo" o "strumento" di utilizzo comune e quotidiano, tanto che (quasi) tutti siamo in qualche modo utenti di servizi informatici. La valenza dell'informatica in termini socio-economici ha scalato in pochi anni la piramide di Anthony, passando da operativa (in sostituzione o a supporto di compiti semplici e ripetitivi), a tattica (a supporto della pianificazione o gestione di breve termine), a strategica. In tale ambito l'informatica è diventata talmente strategica nello sviluppo economico e sociale delle popolazioni che il non poterla sfruttare, uno status ribattezzato con l'espressione divario digitale, è un problema di interesse planetario. Assieme all'elettronica e alle telecomunicazioni unificate insieme sotto la denominazione Tecnologie dell'informazione e della comunicazione (TIC), rappresenta quella disciplina e allo stesso tempo quel settore economico che ha dato vita e sviluppo alla terza rivoluzione industriale attraverso quella che è comunemente nota come rivoluzione digitale. L'informatica si evolve soprattutto nel campo della telefonia.

Un computer (pronuncia italiana: /komˈpjuter/), in italiano elaboratore o calcolatore, è una macchina automatizzata programmabile in grado di eseguire sia complessi calcoli matematici (calcolatore) sia altri tipi di elaborazioni dati (elaboratore).Concepito come una macchina per automatizzare alcune capacità della mente umana, come ad esempio il calcolo e la capacità di memorizzazione potenziandone la portata e applicandole alla soluzione di particolari problemi scientifici e ingegneristici, solo a partire dalla seconda metà del XX secolo, evolve in macchina in grado di eseguire le elaborazioni dati più varie. Ci si riferisce comunemente al computer come ad un dispositivo elettronico e digitale, programmabile a scopo generico, costruito secondo il modello teorico-computazionale della cosiddetta macchina di Turing e la cosiddetta architettura di von Neumann, anche se oggi tuttavia il termine assume il significato più generico di sistema elettronico di elaborazione programmabile e non programmabile, includendo dunque una vasta gamma di tipologie di dispositivi: sebbene i computer programmabili a scopo generico siano oggi i più diffusi, esistono infatti in specifici ambiti di applicazione modelli di computer dedicati a vari campi e settori come automazione industriale, domotica, computer grafica. Nel corso della storia, l'implementazione tecnologica di questa macchina si è modificata profondamente sia nei meccanismi di funzionamento (meccanici, elettromeccanici ed elettronici), che nelle modalità di rappresentazione dell'informazione (analogica e digitale) che in altre caratteristiche (architettura interna, programmabilità, ecc.). In questa forma e al pari della televisione, esso rappresenta il mezzo tecnologico simbolo che ha maggiormente modificato le abitudini umane dopo la seconda guerra mondiale: la sua invenzione ha contribuito alla nascita e allo sviluppo dell'informatica moderna, che ha segnato l'avvento della cosiddetta terza rivoluzione industriale e della società dell'informazione.

Il software (sigla SW, dall'inglese soft «morbido, leggero» e ware «merci, prodotti», su imitazione del termine hardware), traducibile come componente logico, programma informatico o supporto logico, in informatica ed elettronica è l'insieme delle componenti immateriali (strato logico/intangibile) di un sistema elettronico di elaborazione; è contrapposto all'hardware, cioè la parte materiale (strato fisico/tangibile) dello stesso sistema. In particolare in informatica si intendono tali il semplice dato o informazione oppure più propriamente le istruzioni di un programma codificate in linguaggio macchina o in linguaggio di programmazione (codice sorgente), memorizzate su uno o più supporti fisici, sotto forma di codice eseguibile. Riguardo l'invenzione del termine lo statunitense Paul Niquette sostiene di averlo coniato nel 1953, tuttavia è invece ritenuta certa la prima apparizione in una pubblicazione scientifica del 1958 dell'American Mathematical Monthly da parte dello statistico John Wilder Tukey.

Un sistemista (in inglese system administrator o sysadmin), in informatica e telecomunicazioni, è un tecnico specializzato che si occupa dell'installazione, configurazione, gestione (manutenzione, aggiornamento e monitoraggio) di reti informatiche e di telecomunicazioni, o di uno o più sottosistemi di un sistema informatico (es. sistema operativo, database, server, stampante ecc..): ruolo del sistemista è quello di gestire, a livello infrastrutturale, il buon governo dell'hardware e del software del sistema affinché funzionino in modo corretto, ovvero, affinché l'insieme dei servizi offerti dal sistema informativo possa essere erogato nella maniera più efficiente possibile agli utenti (qualità e disponibilità di servizio), divenendone dunque responsabile. Assieme allo sviluppo (programmazione), e al data science costituisce il filone produttivo di business nell'ambito dell'informatica aziendale.

In informatica il mainframe computer (ellissi utilizzata comunemente: mainframe) o sistema centrale è un tipo di computer caratterizzato da prestazioni di elaborazione dati di alto livello di tipo centralizzato, opposto dunque a quello di un sistema distribuito come un cluster computer. Tipicamente sono presenti in grandi sistemi informatici come i centri elaborazione dati o organizzazioni (pubbliche e private) dove sono richiesti elevati livelli di multiutenza, enormi volumi di dati, grandi prestazioni elaborative, unite ad alta affidabilità.

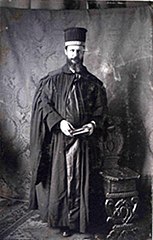

Lucio Mariani (Roma, 4 agosto 1865 – Roma, 30 agosto 1924) è stato un archeologo e docente italiano. Figlio del pittore Cesare, insegnò archeologia e storia antica in varie università italiane. Fu direttore dei Musei capitolini, segretario dell'Accademia di San Luca e membro corrispondente dell'Accademia dei Lincei. Il figlio Valerio è stato uno storico dell'arte, critico d'arte e accademico italiano.

La Laurea in Informatica è un titolo di studio, rilasciato tipicamente da un istituto di istruzione terziaria. Lo studio dell'Informatica prevede l'approfondimento dei fondamenti di teoria e di trattamento automatico dell'Informazione e della Computazione. Nonostante il grande pubblico sia spesso portato erroneamente a credere che tale corso di studi abbia quale obiettivo l'approfondimento del mondo dei calcolatori (Computer) e dei Linguaggi di programmazione, il calcolatore e lo sviluppo di software restano unicamente un mezzo attraverso cui si tratta, manipola e trasferisce l'informazione, e l'informatico non necessariamente deve essere un programmatore o tecnico dei calcolatori (viceversa, un programmatore o un tecnico riparatore di calcolatori non sono definibili automaticamente "informatici"). La capacità di risolvere problemi computazionali dal punto di vista formale ed astratto, e indipendentemente dallo specifico hardware o sistema di calcolo utilizzato, rende bagaglio necessario dell'informatico nozioni avanzate di matematica, algebra, logica ed anche elettronica. L'insegnamento universitario dell'informatica ha avuto una lunga evoluzione. Le prime aziende informatiche e gli enti governativi degli Stati Uniti d'America e del Regno Unito hanno cominciato le collaborazioni con le università negli anni quaranta del secolo scorso. L'informatica è entrata nel panorama dell'insegnamento universitario italiano alla fine degli anni sessanta. Fino alla riforma Gelmini del 2010 in Italia il Corso di Informatica apparteneva alla facoltà di Scienze Matematiche, Fisiche e Naturali, in Inghilterra nella Mathematical, Physical and Life Sciences Division mentre in Francia viene insegnato nelle Faculté des Sciences et technologie e anche nelle grandes écoles. I corsi di laurea italiani di ingegneria informatica tendono ad essere degli ibridi di corsi di laurea più specifici presenti in alcuni paesi esteri, tra cui quelli di lingua anglosassone: computer science, ovvero informatica pura, information technology, riconducibile all'ingegneria delle telecomunicazioni, software engineering, ovvero ingegneria del software e computer engineering. Sebbene quest'ultimo sia il corso di studi più vicino all'ingegneria informatica italiana, nel corso di studi di quest'ultima vengono regolarmente inseriti insegnamenti propri delle altre, come, ad esempio, l'informatica teorica; l'intelligenza artificiale; lo studio delle reti di telecomunicazione e dei protocolli ad esse associati; lo studio dell'elettronica, delle reti logiche e delle componenti hardware dei calcolatori. Per quanto riguarda la durata dei corsi di studio, generalmente le lauree in Informatica o Ingegneria Informatica durano tre anni seguiti da due di Laurea magistrale, mentre fino al 2000 si trattava di lauree a ciclo unico di cinque anni. Dopo la laurea magistrale alcuni dipartimenti offrono corsi di dottorato in informatica.

Sir Isaac Newton (citato anche come Isacco Newton) (Woolsthorpe-by-Colsterworth, 25 dicembre 1642 – Londra, 20 marzo 1726) è stato un matematico, fisico, filosofo naturale, astronomo, teologo, storico e alchimista inglese, considerato uno dei più grandi scienziati di tutti i tempi, ricoprendo anche il ruolo di direttore della zecca inglese e quello di Presidente della Royal Society. Noto soprattutto per il suo contributo alla meccanica classica, contribuì in maniera fondamentale a più di una branca del sapere, occupando una posizione di grande rilievo nella storia della scienza e della cultura in generale, con il suo nome che è associato a una grande quantità di leggi e teorie ancora oggi insegnate: si parla così di dinamica newtoniana, di leggi newtoniane del moto, di legge di gravitazione universale; più in generale ci si riferisce al newtonianesimo come a una concezione del mondo che ha influenzato la cultura europea per tutto il Seicento. Attratto dalla filosofia naturale, ben presto cominciò a leggere le opere di Cartesio, in particolare La geometria del 1637, in cui le curve sono rappresentate per mezzo di equazioni; negli anni in cui era studente a Cambridge alla cattedra presiedevano due figure di grande rilievo, Isaac Barrow e Henry More, che esercitarono una forte influenza sul ragazzo; negli anni seguenti, costruì le sue scoperte matematiche e sperimentali facendo riferimento a un gruppo ristretto di testi: pubblicò i Philosophiae Naturalis Principia Mathematica nel 1687, opera nella quale descrisse la legge di gravitazione universale e, attraverso le sue leggi del moto, costruì le regole fondamentali per la meccanica classica, condividendo con Gottfried Wilhelm Leibniz la paternità dello sviluppo del calcolo differenziale o infinitesimale. Contribuì alla rivoluzione scientifica e al progresso della teoria eliocentrica: a lui si deve la sistematizzazione matematica delle leggi di Keplero sul movimento dei pianeti; oltre a dedurle matematicamente dalla soluzione del problema della dinamica applicata alla forza di gravità (problema dei due corpi) ovvero dalle omonime equazioni di Newton, egli generalizzò queste leggi intuendo che le orbite (come quelle delle comete) potevano essere non solo ellittiche, ma anche iperboliche e paraboliche, dimostrando anche che le medesime leggi della natura governano il movimento della Terra e degli altri corpi celesti. Fu il primo a dimostrare che la luce bianca è composta dalla somma (in frequenza) di tutti gli altri colori, avanzando l'ipotesi che la luce fosse composta da particelle, dando così vita alla teoria corpuscolare della luce, in contrapposizione alla teoria ondulatoria della luce patrocinata dall'astronomo olandese Christiaan Huygens e dall'inglese Thomas Young e corroborata alla fine dell'Ottocento dai lavori di Maxwell e Hertz; la tesi di Newton trovò invece conferme, circa due secoli dopo, con l'introduzione del quanto d'azione da parte di Max Planck (1900) e con l'articolo di Albert Einstein (1905) sull'interpretazione dell'effetto fotoelettrico a partire dal quanto di radiazione elettromagnetica, poi denominato fotone; queste due interpretazioni coesisteranno nell'ambito della meccanica quantistica, come previsto dal dualismo onda-particella.

Il calcolo infinitesimale è la branca fondante dell'analisi matematica che studia il "comportamento locale" di una funzione tramite le nozioni di continuità e limite, usato in quasi tutti i campi della matematica e della fisica, e della scienza in generale. Le funzioni a cui si applica sono a variabile reale o complessa. Tramite la nozione di limite, il calcolo infinitesimale definisce e studia le nozioni di convergenza di una successione o di una serie, continuità, derivata e integrale.