- Libri preferiti

Accedi all'area personale per aggiungere e visualizzare i tuoi libri preferiti

Accedi all'area personale per aggiungere e visualizzare i tuoi libri preferiti

L'algebra lineare è la branca della matematica che si occupa dello studio dei vettori, spazi vettoriali (o spazi lineari), trasformazioni lineari e sistemi di equazioni lineari. Gli spazi vettoriali sono un tema centrale nella matematica moderna; l'algebra lineare è usata ampiamente nell'algebra astratta, nella geometria e nell'analisi funzionale. L'algebra lineare ha inoltre una rappresentazione concreta nella geometria analitica. Con l'algebra lineare si studiano completamente tutti i fenomeni fisici "lineari", cioè quelli in cui intuitivamente non entrano in gioco distorsioni, turbolenze e fenomeni caotici in generale. Anche fenomeni più complessi, non solo della fisica ma anche delle scienze naturali e sociali, possono essere studiati e ricondotti con le dovute approssimazioni a un modello lineare.

In matematica, una σ-algebra (pronunciata sigma-algebra) o tribù (termine introdotto dal gruppo Bourbaki) su di un insieme Ω {\displaystyle \Omega } , è una famiglia di sottoinsiemi di Ω {\displaystyle \Omega } che ha delle proprietà di chiusura rispetto ad alcune operazioni insiemistiche, in particolare l'operazione di unione numerabile e di passaggio al complementare. La struttura di σ-algebra è particolarmente utile nelle teorie della misura e probabilità ed è alla base di tutte le nozioni di misurabilità, sia di insiemi che di funzioni. Essa è un caso particolare di algebra di insiemi e, rispetto a quest'ultima, è utilizzata molto più ampiamente in Analisi (per via delle numerose proprietà che le misure definite su σ-algebre hanno rispetto alle operazioni di passaggio al limite). Le σ-algebre che ricorrono più spesso in matematica sono le σ-algebre boreliane e la σ-algebra di Lebesgue. Anche storicamente queste due classi di σ-algebre hanno motivato lo sviluppo del concetto stesso di σ-algebra, nato a cavallo di XIX secolo e XX secolo col fine di formalizzare la teoria della misura. Esso, infatti, precisa l'idea euristica di evento o insieme misurabile. Molte importanti strutture astratte, al centro dei progressi della matematica dell'ultimo secolo, sono definibili mediante σ-algebre.

L'algebra di Boole (anche detta algebra booleana o reticolo booleano), in matematica e logica matematica, è il ramo dell'algebra in cui le variabili possono assumere solamente i valori vero e falso (valori di verità), generalmente denotati rispettivamente come 1 e 0.

In matematica, la teoria di Galois è una branca superiore dell'algebra astratta. Al livello più semplice usa i gruppi di permutazioni per descrivere come le varie radici di un dato polinomio sono collegate le une con le altre. Questo era l'originale punto di vista di Évariste Galois. L'approccio moderno alla teoria di Galois, sviluppato da Richard Dedekind, Leopold Kronecker e Emil Artin fra gli altri, comprende lo studio degli automorfismi delle estensioni di campi. Ulteriori astrazioni della teoria di Galois si ottengono con la teoria delle connessioni di Galois.

In algebra lineare, il determinante di una matrice quadrata A {\displaystyle A} è un numero che descrive alcune proprietà algebriche e geometriche della matrice. Esso viene generalmente indicato con det ( A ) {\displaystyle \det(A)} e, a volte, con | A | {\displaystyle |A|} . Quest'ultima notazione è più compatta, ma anche più ambigua, in quanto utilizzata talvolta per descrivere una norma della matrice.Il determinante è un potente strumento usato in vari settori della matematica: innanzitutto nello studio dei sistemi di equazioni lineari, quindi nel calcolo infinitesimale a più dimensioni (ad esempio nello Jacobiano), nel calcolo tensoriale, nella geometria differenziale, nella teoria combinatoria, ecc. Il significato geometrico principale del determinante si ottiene interpretando la matrice quadrata A {\displaystyle A} di ordine n {\displaystyle n} come trasformazione lineare di uno spazio vettoriale a n {\displaystyle n} dimensioni: con questa interpretazione, il valore assoluto di det ( A ) {\displaystyle \det(A)} è il fattore con cui vengono modificati i volumi degli oggetti contenuti nello spazio (anche se ciò è improprio senza considerare il significato di misura). Se è diverso da zero, il segno del determinante indica inoltre se la trasformazione A {\displaystyle A} preserva o cambia l'orientazione dello spazio rispetto agli assi di riferimento.

In matematica, in particolare in algebra, un campo finito (detto a volte anche campo di Galois) è un campo che contiene un numero finito di elementi. I campi finiti sono importanti in teoria dei numeri, geometria algebrica, teoria di Galois, in crittografia e in teoria dei codici. I campi finiti sono completamente classificati.

In matematica, un campo è una struttura algebrica composta da un insieme non vuoto K {\displaystyle K} e da due operazioni binarie interne, chiamate somma e prodotto e indicate di solito rispettivamente con + {\displaystyle +} e ∗ {\displaystyle *} . Queste godono di proprietà assimilabili a quelle verificate da somma e prodotto sui numeri razionali o reali o anche complessi. Il campo è una struttura algebrica basilare in matematica, necessaria per lo studio approfondito dei polinomi e delle loro radici, e per la definizione degli spazi vettoriali. Nel contesto degli spazi vettoriali un elemento di un campo è detto scalare.

Niels Henrik Abel (Finnøy, 5 agosto 1802 – Froland, 6 aprile 1829) è stato un matematico norvegese, noto soprattutto per i suoi fondamentali contributi all'algebra ed alla teoria delle funzioni; ricordato inoltre per il premio che porta il suo nome.

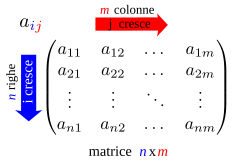

In matematica, in particolare in algebra lineare, una matrice è una tabella ordinata di elementi. Ad esempio: ( 1 0 5 1 − 2 0 ) {\displaystyle {\begin{pmatrix}1&0&5\\1&-2&0\end{pmatrix}}} Le matrici sono ampiamente usate in matematica e in tutte le scienze per la loro capacità di rappresentare in maniera utile e concisa diversi oggetti matematici, come valori che dipendono da due parametri o anche sistemi lineari, cosa, quest'ultima, che le rende uno strumento centrale dell'analisi matematica.